En el artículo anterior de esta serie hablé de por qué el gobierno de la IA tiene que ser el primer paso antes de escalar su adopción. De por qué un Comité de IA no es un freno, sino exactamente lo contrario: el mecanismo que permite moverse rápido con criterio.

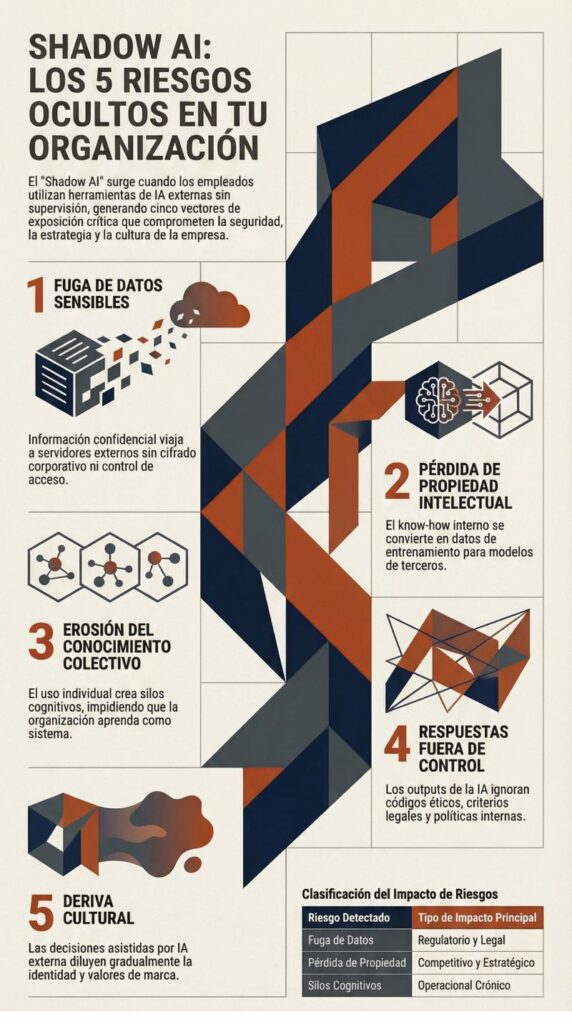

Hoy quiero ir un paso atrás. Porque antes de diseñar el gobierno, hay que entender qué está pasando ya dentro de la organización. Y lo que está pasando tiene nombre: Shadow AI.

Todas las organizaciones que no gobiernan la IA tienen Shadow AI. No es una hipótesis, es una certeza. Cualquier empleado que usa ChatGPT para redactar un informe, Copilot para analizar datos o cualquier herramienta de IA gratuita para acelerar su trabajo está generando Shadow AI. Lo hace con buena intención. Lo hace para ser más productivo. Y lo hace sin que la organización lo haya decidido.

El problema no es la intención. El problema es la ausencia de control. Y esa ausencia tiene un coste concreto, que se manifiesta en cinco riesgos que tu empresa ya está corriendo hoy.

Riesgo 1: Fuga de datos sensibles

Cuando un empleado introduce información en una herramienta de IA externa no corporativa, esa información sale de la organización. Contratos, datos de clientes, proyecciones financieras, estrategia interna. Todo lo que se escribe en un prompt viaja a servidores externos, sin cifrado corporativo, sin auditoría, sin control de acceso.

El riesgo no es teórico. Es regulatorio. El RGPD, la AI Act europea y las normativas sectoriales establecen responsabilidades claras sobre dónde y cómo se procesan los datos. La ignorancia no exime de responsabilidad.

Tipo de riesgo: regulatorio y legal.

Riesgo 2: Pérdida de propiedad intelectual

Los modelos de IA aprenden. Y en muchos casos, aprenden de los datos que sus usuarios introducen. Cuando un empleado describe un proceso interno, una metodología propietaria o una ventaja competitiva en un prompt, ese conocimiento puede convertirse en dato de entrenamiento de un modelo de terceros.

Tu know-how sale. Sin billete de vuelta. Sin que nadie lo haya decidido conscientemente.

Tipo de riesgo: competitivo y estratégico.

Riesgo 3: Erosión del conocimiento colectivo

Este es el riesgo menos visible y probablemente el más dañino a largo plazo. Cuando cada empleado usa su propia herramienta de IA de forma individual, el conocimiento que genera esa interacción queda atrapado en silos cognitivos. Nadie sabe qué sabe el de al lado. Los aprendizajes no se comparten, no se acumulan, no se convierten en ventaja organizacional.

La organización pierde la capacidad de aprender como sistema. Y eso es exactamente lo contrario de lo que la IA debería hacer posible.

Tipo de riesgo: operacional crónico.

Riesgo 4: Respuestas fuera de control

La IA no conoce tus políticas internas. No conoce tu manual de cumplimiento, tu código ético, tus procedimientos de aprobación ni tus criterios legales. Cuando un empleado usa Shadow AI para redactar comunicaciones, elaborar propuestas o tomar decisiones, los outputs no están alineados con ninguno de esos criterios.

El resultado: respuestas inconsistentes, potencialmente erróneas y en algunos casos legalmente problemáticas. Sin que nadie haya revisado nada.

Tipo de riesgo: reputacional y operacional.

Riesgo 5: Deriva cultural

La IA habla por tu empresa. Cuando un empleado usa una herramienta no corporativa para comunicarse con clientes, elaborar contenido o tomar decisiones, la IA que hay detrás no conoce los valores de la compañía, no conoce el tono de marca, no conoce la cultura organizacional.

Con el tiempo, las decisiones asistidas por IA empiezan a divergir de la identidad de la empresa. No de golpe. Gradualmente. Hasta que la organización ya no reconoce su propio reflejo.

Tipo de riesgo: estratégico y cultural.

Conclusión

Cinco riesgos. Cinco vectores de exposición que no dependen de que hayas tomado una decisión equivocada. Dependen de que todavía no hayas tomado ninguna.

El coste de la inacción no es neutro. Cada día sin una estrategia de gobierno de IA es un día en que estos riesgos se acumulan silenciosamente.

La respuesta a estos cinco riesgos no es tecnológica, es de gobierno, de tomar conciencia y tomar decisiones. En el primer artículo de esta serie expliqué por qué establecer un Comité de IA es el prerequisito antes de escalar… y por qué las organizaciones que se saltan ese paso pagan un coste mucho mayor después (puedes encontrar un enlace al primer artículo en los comentarios).

¿Cuánto tiempo lleva tu organización conviviendo con estos riesgos sin saberlo… o sabiéndolo y mirando a otro lado?

Autor: Toni Parada